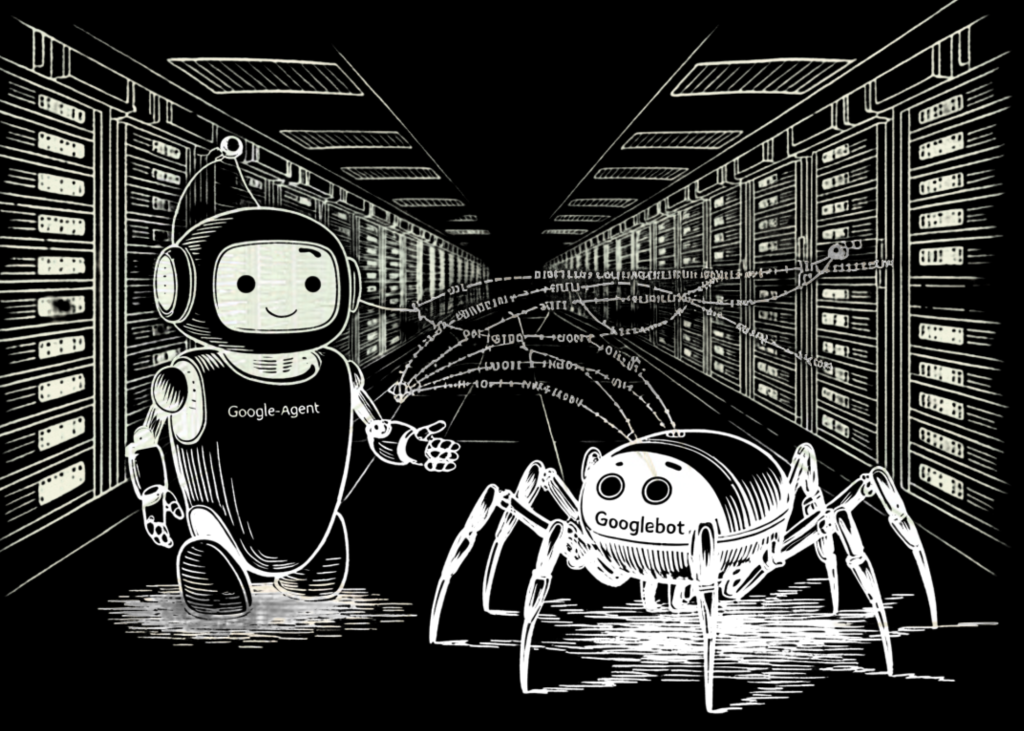

Google vừa âm thầm đưa vào hoạt động một thực thể kỹ thuật mới tên là Google-Agent — và nó không hoạt động theo bất kỳ quy tắc nào mà các nhà phát triển web đã quen thuộc suốt nhiều thập kỷ qua. Điểm khác biệt lớn nhất: không giống Googlebot truyền thống, Google-Agent có thể bỏ qua file robots.txt — tấm "biển cấm" mà chủ website dùng để ngăn bot vào nhà. Đây là điều cả cộng đồng lập trình viên lẫn chủ website cần hiểu ngay.

Google-Agent là gì và tại sao nó xuất hiện?

Khi Google tích hợp AI vào hàng loạt sản phẩm như Google Search AI Overviews, Gemini và các công cụ AI khác, hệ thống cần một cách mới để lấy dữ liệu từ web theo thời gian thực. Google-Agent chính là thực thể được tạo ra cho mục đích đó.

Khác với Googlebot — con bot đã lập lịch tự động crawl toàn bộ internet để xây dựng chỉ mục tìm kiếm — Google-Agent chỉ hoạt động khi có người dùng thực sự yêu cầu. Ví dụ: khi bạn hỏi Gemini về một bài viết cụ thể, Google-Agent sẽ truy cập URL đó ngay lập tức để lấy nội dung mới nhất.

Điểm mấu chốt cần nhớ

Google-Agent không phải bot crawl web — nó là "proxy" đại diện cho người dùng thực sự đang dùng AI. Vì vậy Google xem nó như hành động của người dùng, không phải hành động của máy móc tự động.

Sự khác biệt cốt lõi: Bot tự động vs. Bot phản ứng

Có hai loại thực thể hoàn toàn khác nhau đang truy cập website của bạn từ phía Google:

Googlebot (crawler tự động): Hoạt động theo lịch do thuật toán Google quyết định. Nó chủ động dạo khắp internet, theo dõi các liên kết, và xây dựng chỉ mục tìm kiếm. Loại này tuân thủ nghiêm ngặt file robots.txt.

Google-Agent (fetcher phản ứng): Chỉ hoạt động khi người dùng thực hiện một hành động cụ thể — như đặt câu hỏi cho AI. Nó không "dạo" web, không theo liên kết, chỉ truy cập đúng URL được yêu cầu. Và quan trọng nhất: nó bỏ qua robots.txt.

Nhận diện Google-Agent trong log máy chủ

Nếu bạn quản lý website, đây là thông tin kỹ thuật quan trọng. Google-Agent tự nhận diện qua chuỗi User-Agent sau:

Một điểm cần lưu ý: không giống Googlebot vốn đến từ các dải IP cố định và dễ dự đoán, Google-Agent có thể xuất hiện từ nhiều địa chỉ IP khác nhau hơn. Google khuyến nghị dùng danh sách JSON IP ranges chính thức của họ để xác minh tính hợp lệ của các request này.

Tại sao điều này quan trọng với người quản lý website?

Việc Google-Agent xuất hiện kéo theo một loạt thay đổi trong cách quản lý hạ tầng web:

Thứ nhất, nếu tường lửa ứng dụng web (WAF) hoặc phần mềm giới hạn tốc độ của bạn đang chặn tất cả "bot" theo kiểu đánh đồng, bạn có thể vô tình ngăn người dùng thực sự tương tác với nội dung của mình qua các công cụ AI của Google.

Thứ hai, vì robots.txt không kiểm soát được Google-Agent, bạn không thể dùng nó để ẩn dữ liệu nhạy cảm khỏi các AI fetcher. Cách duy nhất để kiểm soát quyền truy cập là dùng xác thực tiêu chuẩn hoặc phân quyền phía máy chủ — giống như với người dùng thật.

Thứ ba, lưu lượng từ Google-Agent sẽ tăng giảm theo độ phổ biến của nội dung trong cộng đồng người dùng AI, không theo chu kỳ crawl của Google. Điều này có nghĩa là traffic có thể đến theo từng đợt bùng phát bất ngờ.

Điều này có nghĩa gì với bạn?

Nếu bạn chỉ là người dùng AI thông thường, tin tốt là: các công cụ như Gemini giờ có thể lấy thông tin tươi hơn, chính xác hơn từ web khi bạn đặt câu hỏi.

Nếu bạn có website, blog, hay cửa hàng online: đây là lúc cần xem lại chiến lược bảo vệ nội dung. File robots.txt không còn là đủ nếu bạn muốn kiểm soát AI có thể đọc gì từ trang của mình. Hãy nghĩ đến việc dùng xác thực, login wall, hoặc các biện pháp phân quyền phía máy chủ cho những nội dung bạn không muốn AI tự do truy cập.

Về bức tranh lớn hơn: Google đang dần chuyển từ mô hình "lập lịch crawl" sang mô hình "phản ứng theo người dùng thời gian thực". Đây là dấu hiệu rõ ràng cho thấy AI không chỉ thay đổi cách chúng ta tìm kiếm thông tin — nó đang thay đổi cả cách internet vận hành ở tầng kỹ thuật sâu nhất.

Tóm tắt những điều cần nhớ

- Google-Agent là thực thể AI mới, chỉ hoạt động khi người dùng yêu cầu — không tự động crawl như Googlebot

- Google-Agent bỏ qua robots.txt vì được xem là hành động của người dùng, không phải bot tự động

- Chủ website cần dùng xác thực và phân quyền phía máy chủ để kiểm soát AI fetcher, không thể dựa vào robots.txt

- Lập trình viên cần cập nhật cấu hình WAF để không chặn nhầm Google-Agent hợp lệ

- Đây là dấu hiệu Google đang chuyển sang mô hình tương tác web theo thời gian thực thay vì crawl định kỳ