Một mô hình AI nhỏ gọn nhưng 'nhìn' cực kỳ sắc bén

Hãy tưởng tượng bạn chỉ cần gõ "cái ghế màu đỏ ở góc trái" và AI lập tức khoanh vùng chính xác vật thể đó trong ảnh — không cần huấn luyện thêm, không cần chỉ định loại vật thể trước. Đó chính xác là điều Falcon Perception của Viện Đổi mới Công nghệ TII vừa làm được, với kích thước chỉ 600 triệu tham số — nhỏ hơn rất nhiều so với các mô hình thị giác đương thời.

Vấn đề với cách AI "nhìn" truyền thống

Trong nhiều năm qua, các hệ thống thị giác máy tính hoạt động theo kiểu "lắp ghép Lego": một mô hình chuyên trích xuất đặc trưng hình ảnh, một mô hình khác chuyên dự đoán kết quả. Cách làm này hiệu quả nhưng cồng kềnh — hai hệ thống riêng biệt khó phối hợp với nhau, tốn tài nguyên và khó mở rộng quy mô.

Đặc biệt, khi bạn muốn AI hiểu ngôn ngữ tự nhiên để tìm vật thể trong ảnh, việc kết nối hai khối riêng biệt này tạo ra "nút thắt cổ chai" — ngôn ngữ và thị giác không thực sự "nói chuyện" được với nhau một cách tự nhiên.

Falcon Perception giải quyết bài toán này như thế nào?

TII chọn một hướng đi khác hoàn toàn: một Transformer duy nhất xử lý cả ảnh lẫn văn bản ngay từ lớp đầu tiên. Thay vì hai khối riêng biệt, toàn bộ thông tin hình ảnh và ngôn ngữ được "trộn lẫn" trong cùng một không gian tham số từ đầu đến cuối.

Kỹ thuật này gọi là early fusion — hợp nhất sớm — và nó cho phép mô hình học được mối liên hệ giữa từ ngữ và vùng ảnh một cách tự nhiên hơn, thay vì phải "dịch" qua lại giữa hai hệ thống.

Những chi tiết kỹ thuật thú vị bên trong

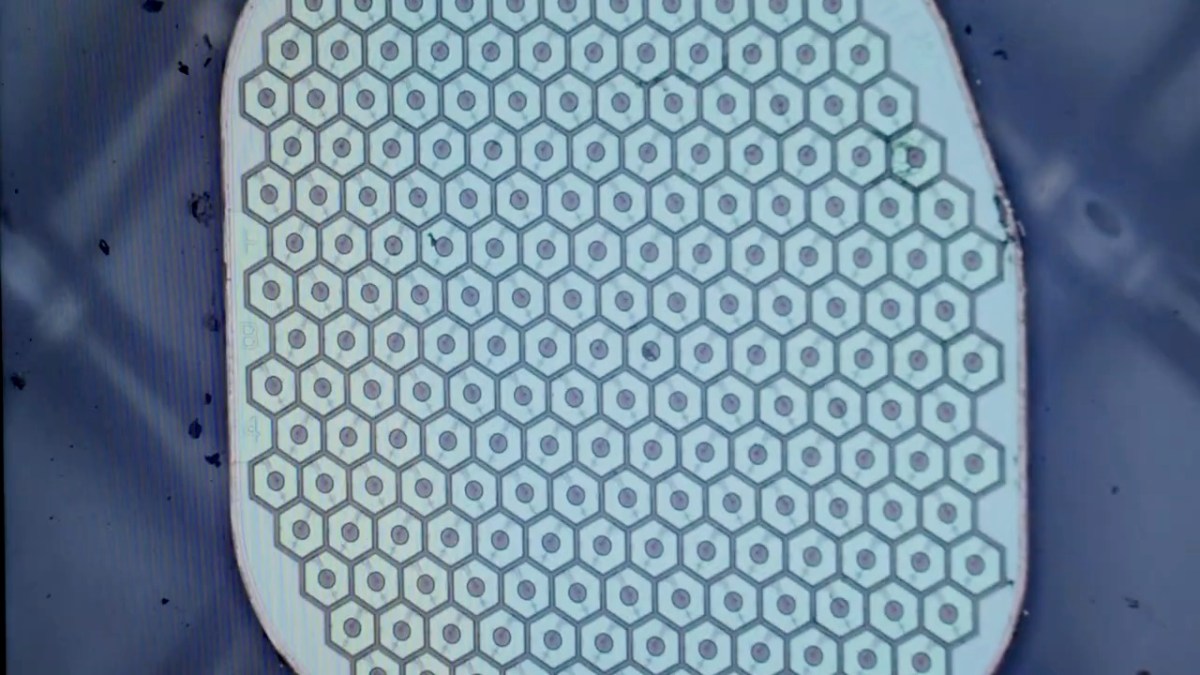

Falcon Perception sử dụng một cơ chế chú ý lai thông minh: các token ảnh "nhìn" nhau theo cả hai chiều để xây dựng bức tranh toàn cảnh, trong khi các token văn bản và nhiệm vụ chỉ nhìn về phía trước theo kiểu tự hồi quy — giống như cách con người đọc câu từ trái sang phải.

Để giữ nguyên thông tin vị trí 2D khi ảnh được "trải phẳng" thành chuỗi token, nhóm nghiên cứu dùng 3D Rotary Positional Embeddings với kỹ thuật GGROPE, giúp mô hình nhận biết vị trí tương đối của các vùng ảnh dù ảnh bị xoay hay có tỷ lệ khung hình khác nhau.

Khi dự đoán nhiều vật thể, mô hình xử lý theo thứ tự raster — từ trên xuống dưới, từ trái sang phải — cách này được chứng minh hội tụ nhanh hơn và cho kết quả tọa độ chính xác hơn so với thứ tự ngẫu nhiên.

Tại sao thứ tự raster quan trọng?

Khi AI phải dự đoán vị trí nhiều vật thể cùng lúc, thứ tự xử lý ảnh hưởng lớn đến độ chính xác. Thứ tự raster (trái sang phải, trên xuống dưới) phản ánh cách con người tự nhiên quét một bức ảnh, giúp mô hình học nhanh hơn và ổn định hơn.

Huấn luyện thông minh với 685 tỷ token

Mô hình được khởi tạo bằng cách chưng cất kiến thức từ các mô hình lớn hơn, sau đó trải qua ba giai đoạn huấn luyện nhận thức:

- Giai đoạn 1: Học "kiểm kê" cảnh vật — liệt kê toàn bộ những gì có trong ảnh để xây dựng ngữ cảnh tổng thể.

- Giai đoạn 2: Chuyển sang trả lời từng câu hỏi độc lập, đảm bảo mô hình định vị vật thể dựa thuần túy vào ảnh.

- Giai đoạn 3: Tinh chỉnh ngữ cảnh dài, tăng giới hạn lên 600 mask mỗi biểu thức để xử lý cảnh vật dày đặc.

So sánh với SAM 3 — kết quả gây bất ngờ

TII cũng tự xây dựng một benchmark mới tên PBench, chia các mẫu thành 5 cấp độ phức tạp ngữ nghĩa để đánh giá chính xác hơn. Kết quả cho thấy Falcon Perception vượt trội SAM 3 — đặc biệt ở các nhiệm vụ ngữ nghĩa phức tạp và hiểu không gian (Level 3), dù kích thước mô hình nhỏ hơn đáng kể.

Ngoài ra, TII còn phát triển thêm FalconOCR — một mô hình 300 triệu tham số chuyên biệt cho nhận dạng văn bản trong tài liệu, cũng được xây dựng trên nền tảng early-fusion tương tự.

Điều này có nghĩa gì với bạn?

Nếu bạn đang dùng AI để xử lý ảnh — dù là tìm kiếm sản phẩm, phân tích tài liệu, hay xây dựng ứng dụng — Falcon Perception đại diện cho một xu hướng quan trọng: AI thị giác ngày càng nhỏ hơn nhưng thông minh hơn.

Với chỉ 600 triệu tham số, mô hình này có thể chạy trên phần cứng phổ thông hơn, mở ra khả năng tích hợp vào thiết bị di động hoặc máy chủ chi phí thấp. Với các nhà phát triển Việt Nam đang xây dựng ứng dụng AI, đây là tín hiệu tốt: bạn không cần mô hình khổng lồ để có được khả năng nhận diện hình ảnh từ ngôn ngữ tự nhiên ở mức chuyên nghiệp.

Điểm cốt lõi cần nhớ

- TII ra mắt Falcon Perception — mô hình thị giác 600 triệu tham số có thể nhận diện và phân vùng vật thể từ mô tả ngôn ngữ tự nhiên

- Kiến trúc early-fusion hợp nhất ảnh và văn bản trong một Transformer duy nhất, khác hoàn toàn cách tiếp cận truyền thống hai khối riêng biệt

- Mô hình vượt trội SAM 3 trên benchmark PBench mới, đặc biệt ở các nhiệm vụ hiểu không gian phức tạp

- FalconOCR 300 triệu tham số là sản phẩm phụ chuyên nhận dạng văn bản tài liệu, cùng kiến trúc

- Xu hướng mô hình nhỏ nhưng mạnh mở ra cơ hội triển khai AI thị giác trên phần cứng phổ thông hơn