Trong một diễn biến độc quyền được TechCrunch tiết lộ mới đây, startup Thinking Machines Lab của cựu Giám đốc Công nghệ OpenAI Mira Murati đã chính thức ký kết một thỏa thuận trị giá hàng tỷ đô la với Google Cloud. Hợp tác chiến lược này nhằm mục đích mở rộng việc sử dụng hạ tầng trí tuệ nhân tạo (AI) tiên tiến của Google, đặc biệt là các hệ thống được trang bị chip GB300 mới nhất của Nvidia, qua đó củng cố vị thế của Google trong cuộc đua cung cấp nền tảng cho các phòng thí nghiệm AI hàng đầu thế giới.

Thỏa thuận tỷ đô giữa Thinking Machines và Google Cloud: Chi tiết quan trọng

Theo nguồn tin thân cận, thỏa thuận này có giá trị lên tới hàng tỷ đô la, cho phép Thinking Machines tiếp cận các hệ thống AI mới nhất của Google được xây dựng trên nền tảng chip Nvidia GB300. Ngoài ra, gói hợp tác còn bao gồm các dịch vụ hạ tầng toàn diện để hỗ trợ quá trình huấn luyện và triển khai mô hình AI. Đây là một bước đi quan trọng, không chỉ với Thinking Machines mà còn với cả Google Cloud, khi họ đang nỗ lực củng cố mối quan hệ với các nhà phát triển AI tiên phong.

Mặc dù Thinking Machines đã từng hợp tác với Nvidia và nhận được đầu tư từ nhà sản xuất chip này vào đầu năm, đây là lần đầu tiên startup này ký kết một thỏa thuận lớn với một nhà cung cấp dịch vụ đám mây. Điều đáng chú ý là thỏa thuận này không độc quyền, cho phép Thinking Machines có thể sử dụng nhiều nhà cung cấp đám mây khác trong tương lai. Tuy nhiên, nó vẫn là một tín hiệu rõ ràng cho thấy Google đang tìm cách "khóa chặt" các phòng thí nghiệm AI đang phát triển nhanh chóng ngay từ giai đoạn đầu.

Google Cloud tăng cường vị thế trong cuộc đua hạ tầng AI

Google đã và đang tích cực ký kết nhiều thỏa thuận đám mây với các nhà phát triển AI, với mục tiêu tích hợp các dịch vụ đám mây của mình với các dịch vụ khác như lưu trữ, công cụ Kubernetes và Spanner (sản phẩm cơ sở dữ liệu của họ). Đầu tháng này, Anthropic cũng đã ký một thỏa thuận với Google và Broadcom để đảm bảo dung lượng TPU (Tensor Processing Unit) khổng lồ – chip AI tùy chỉnh của Google dành cho các tác vụ học máy.

Thỏa thuận với Thinking Machines là một phần trong chiến lược rộng lớn hơn của Google nhằm định vị Google Cloud như một nền tảng ưu việt cho phát triển AI, thu hút các startup tiên phong bằng cách cung cấp hạ tầng mạnh mẽ và dịch vụ tích hợp.

Tuy nhiên, cuộc cạnh tranh trong lĩnh vực này vô cùng khốc liệt. Ngay trong tuần đó, Anthropic cũng đã ký một thỏa thuận mới với Amazon để đảm bảo tới 5 gigawatt dung lượng cho việc huấn luyện và triển khai mô hình Claude của họ. Điều này cho thấy các startup AI lớn thường không muốn phụ thuộc vào một nhà cung cấp duy nhất, tạo ra một thị trường cạnh tranh sôi động giữa các ông lớn công nghệ.

Thinking Machines của Mira Murati: Bí ẩn và đột phá AI

Mira Murati, cựu Giám đốc Công nghệ của OpenAI, đã rời vị trí của mình và thành lập Thinking Machines vào tháng 2 năm 2025. Công ty này, ngay sau đó đã huy động được vòng hạt giống 2 tỷ đô la với định giá 12 tỷ đô la, vẫn giữ bí mật cao độ về hoạt động của mình. Đến tháng 10 cùng năm, Thinking Machines đã ra mắt sản phẩm đầu tiên của mình, có tên là Tinker. Tinker là một công cụ tự động hóa việc tạo ra các mô hình AI tiên phong tùy chỉnh, hứa hẹn sẽ cách mạng hóa cách các doanh nghiệp và nhà nghiên cứu phát triển AI.

Câu hỏi thường gặp

Thinking Machines là công ty gì?

Thinking Machines là một startup AI được thành lập bởi cựu CTO OpenAI Mira Murati vào tháng 2 năm 2025. Công ty này chuyên phát triển các công cụ tự động hóa việc tạo ra các mô hình AI tiên phong tùy chỉnh, với sản phẩm đầu tiên là Tinker.

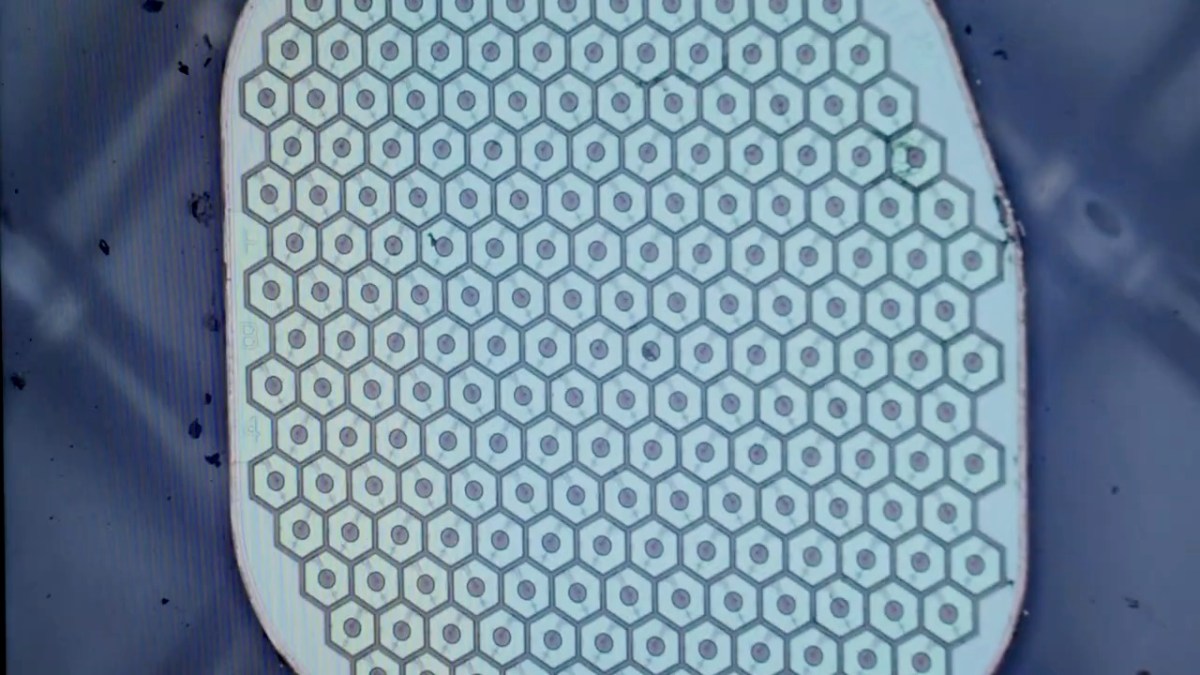

Chip Nvidia GB300 có vai trò gì trong thỏa thuận này?

Chip Nvidia GB300 là một phần quan trọng của thỏa thuận, cung cấp khả năng tăng tốc độ huấn luyện và phục vụ mô hình lên gấp đôi so với các thế hệ GPU trước. Điều này giúp Thinking Machines xử lý các tác vụ học tăng cường (reinforcement learning) cực kỳ tốn kém về mặt tính toán một cách hiệu quả hơn.

Thỏa thuận với Google Cloud đã cung cấp một số thông tin chi tiết về những gì Thinking Machines đang phát triển. Trong một thông cáo báo chí, Google lưu ý rằng họ có thể hỗ trợ các tác vụ học tăng cường (reinforcement learning) của startup này, một kiến trúc mà Tinker đang dựa vào. Học tăng cường là một phương pháp huấn luyện đã tạo nên những đột phá gần đây tại các phòng thí nghiệm như DeepMind và OpenAI, và quy mô của thỏa thuận với Google Cloud phản ánh chi phí tính toán khổng lồ mà công việc này đòi hỏi.

Sức mạnh của chip Nvidia GB300 và học tăng cường

Việc Thinking Machines là một trong những khách hàng đầu tiên của Google Cloud được tiếp cận các hệ thống chạy chip GB300 của Nvidia cho thấy sự ưu tiên và tầm quan trọng của công nghệ này. Theo Google, các hệ thống được trang bị GB300 mang lại hiệu suất cải thiện gấp 2 lần về tốc độ huấn luyện và phục vụ mô hình so với các GPU thế hệ trước. Điều này là cực kỳ quan trọng đối với các công ty như Thinking Machines, nơi mà việc phát triển các mô hình AI tiên phong đòi hỏi sức mạnh tính toán vượt trội.

“Google Cloud đã giúp chúng tôi hoạt động với tốc độ kỷ lục cùng độ tin cậy mà chúng tôi yêu cầu.”

"Google Cloud đã giúp chúng tôi hoạt động với tốc độ kỷ lục cùng độ tin cậy mà chúng tôi yêu cầu."

Học tăng cường (Reinforcement Learning - RL) là một lĩnh vực của học máy, nơi một tác nhân học cách đưa ra quyết định bằng cách thực hiện các hành động trong một môi trường và nhận phản hồi dưới dạng phần thưởng hoặc hình phạt. Phương pháp này đã được ứng dụng thành công trong nhiều lĩnh vực từ chơi game (AlphaGo của DeepMind) đến robot và tự động hóa. Tuy nhiên, việc huấn luyện các mô hình RL thường đòi hỏi lượng lớn dữ liệu và tài nguyên tính toán, khiến việc tiếp cận hạ tầng mạnh mẽ như Google Cloud trở nên thiết yếu.

Google Cloud hỗ trợ các startup AI tiên phong như thế nào?

Thỏa thuận này không chỉ là một chiến thắng cho Google Cloud mà còn là một minh chứng cho vai trò ngày càng tăng của các nhà cung cấp dịch vụ đám mây trong việc thúc đẩy đổi mới AI. Bằng cách cung cấp quyền truy cập vào các GPU tiên tiến nhất và các dịch vụ hạ tầng tích hợp, Google đang tạo điều kiện cho các startup như Thinking Machines tập trung vào nghiên cứu và phát triển mà không phải lo lắng về việc xây dựng và duy trì cơ sở hạ tầng tốn kém.

Ưu điểm cho Google Cloud

- Củng cố vị thế dẫn đầu trong hạ tầng AI.

- Thu hút các startup AI tiên phong, tạo ra hệ sinh thái mạnh mẽ.

- Tăng doanh thu từ dịch vụ đám mây AI.

- Định vị Google Cloud như một đối tác chiến lược quan trọng.

Thách thức và rủi ro

- Cạnh tranh gay gắt từ AWS, Microsoft Azure.

- Chi phí đầu tư lớn vào hạ tầng GPU và TPU.

- Nguy cơ các startup sử dụng đa nhà cung cấp, giảm sự phụ thuộc.

- Yêu cầu liên tục đổi mới để duy trì lợi thế công nghệ.

Myle Ott, một nhà nghiên cứu sáng lập tại Thinking Machines, đã nhấn mạnh sự hài lòng của mình: "Google Cloud đã giúp chúng tôi hoạt động với tốc độ kỷ lục cùng độ tin cậy mà chúng tôi yêu cầu." Lời nhận xét này không chỉ là một lời khen mà còn là một minh chứng cho khả năng của Google Cloud trong việc đáp ứng nhu cầu khắt khe của các phòng thí nghiệm AI hàng đầu.

Thị trường đám mây AI: Cuộc chiến không ngừng nghỉ

Thị trường đám mây AI đang chứng kiến một cuộc chiến gay gắt giữa các ông lớn công nghệ. Mỗi nhà cung cấp đều muốn trở thành lựa chọn hàng đầu cho các công ty và startup AI, cung cấp không chỉ sức mạnh tính toán mà còn cả một hệ sinh thái dịch vụ toàn diện. Các thỏa thuận như giữa Google Cloud và Thinking Machines, hay giữa Anthropic với cả Google và Amazon, cho thấy rằng các startup AI hàng đầu đang có vị thế đàm phán mạnh mẽ và có thể tận dụng sự cạnh tranh này để đạt được những điều khoản tốt nhất.

Việc các công ty như Thinking Machines không cam kết độc quyền với một nhà cung cấp đám mây duy nhất cũng là một xu hướng đáng chú ý. Điều này cho phép họ linh hoạt hơn, giảm thiểu rủi ro phụ thuộc vào một nền tảng duy nhất và có thể tối ưu hóa chi phí cũng như hiệu suất bằng cách sử dụng các dịch vụ tốt nhất từ nhiều nhà cung cấp khác nhau. Tuy nhiên, đối với Google, việc "khóa chặt" các phòng thí nghiệm tiên phong này sớm là một chiến lược quan trọng để đảm bảo vị thế dẫn đầu trong dài hạn.

Điều này có nghĩa gì với bạn?

Đối với độc giả của "Tình Báo AI", thỏa thuận này mang nhiều ý nghĩa quan trọng. Thứ nhất, nó cho thấy tốc độ phát triển chóng mặt của ngành AI, nơi các startup mới thành lập đã có thể huy động hàng tỷ đô la và ký kết các hợp đồng lớn với các ông lớn công nghệ. Thứ hai, việc các công ty như Google đầu tư mạnh vào hạ tầng AI và hỗ trợ các phòng thí nghiệm tiên phong sẽ thúc đẩy nhanh chóng những đột phá công nghệ, mang lại các mô hình AI mạnh mẽ hơn và ứng dụng rộng rãi hơn trong tương lai.

Cuối cùng, sự cạnh tranh giữa các nhà cung cấp đám mây như Google Cloud, AWS và Azure sẽ mang lại lợi ích cho toàn bộ hệ sinh thái AI, từ các nhà phát triển đến người dùng cuối. Nó đảm bảo rằng các công nghệ AI tiên tiến nhất sẽ ngày càng dễ tiếp cận hơn, hiệu quả hơn và đáng tin cậy hơn, mở ra những cánh cửa mới cho sự sáng tạo và đổi mới trong mọi lĩnh vực của đời sống.

Điểm Chính Cần Nhớ

- Thinking Machines của cựu CTO OpenAI Mira Murati đã ký thỏa thuận tỷ đô với Google Cloud để sử dụng hạ tầng AI tiên tiến, bao gồm chip Nvidia GB300.

- Thỏa thuận này củng cố chiến lược của Google Cloud nhằm thu hút và hỗ trợ các startup AI tiên phong, mặc dù không độc quyền.

- Sản phẩm Tinker của Thinking Machines dựa trên học tăng cường, đòi hỏi sức mạnh tính toán khổng lồ, được đáp ứng bởi hạ tầng của Google Cloud.

- Thị trường đám mây AI đang chứng kiến cuộc cạnh tranh gay gắt giữa các ông lớn, thúc đẩy đổi mới và mang lại lợi ích cho toàn bộ hệ sinh thái AI.