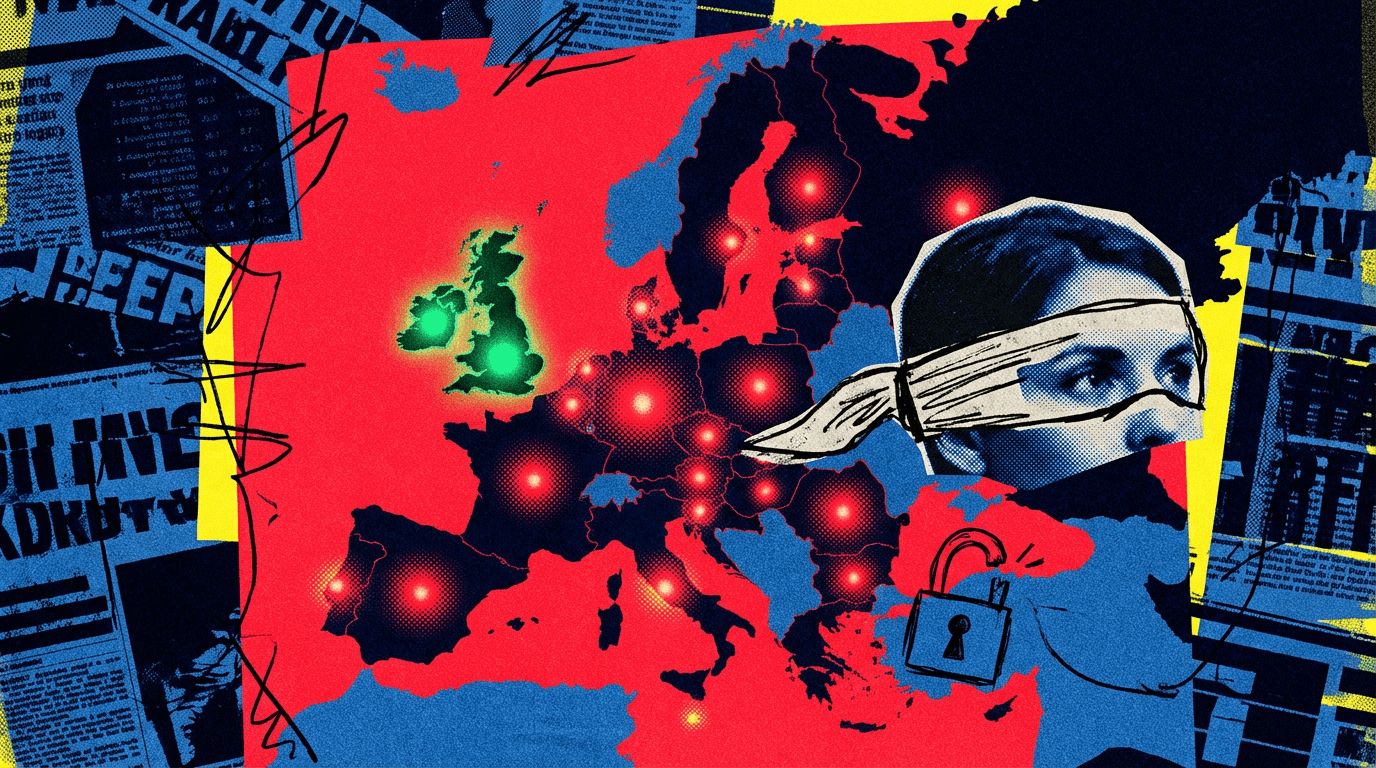

Trong bối cảnh công nghệ trí tuệ nhân tạo (AI) phát triển như vũ bão, một mô hình AI mới mang tên Claude Mythos của Anthropic đã trở thành hồi chuông cảnh tỉnh cho các cơ quan an ninh mạng châu Âu. Được cho là có khả năng phát hiện lỗ hổng bảo mật vượt trội hơn hầu hết con người, Claude Mythos đang bị Anthropic hạn chế quyền truy cập, khiến Liên minh châu Âu (EU) gặp khó khăn trong việc đánh giá rủi ro và đảm bảo an toàn AI, trong khi Anh Quốc đã nhanh chóng tiến hành các thử nghiệm độc lập. Tình hình này không chỉ phơi bày sự thiếu đồng bộ trong cách tiếp cận AI giữa các quốc gia mà còn đặt ra những câu hỏi nghiêm túc về năng lực kiểm định và chủ quyền công nghệ của châu Âu trong kỷ nguyên AI.

Anthropic và Claude Mythos: Mô hình AI có gì đặc biệt?

Claude Mythos là một mô hình AI tiên tiến do Anthropic, một trong những công ty hàng đầu về AI, phát triển. Điểm đặc biệt của Mythos nằm ở khả năng vượt trội trong việc xác định và phát hiện các lỗ hổng bảo mật trong hệ thống phần mềm. Theo Anthropic, mô hình này có thể thực hiện công việc này hiệu quả hơn rất nhiều so với các chuyên gia an ninh mạng là con người. Điều này biến Claude Mythos trở thành một công cụ tiềm năng cực kỳ mạnh mẽ, không chỉ trong việc củng cố an ninh mạng mà còn có thể bị lạm dụng cho các mục đích tấn công.

Với sức mạnh đáng gờm này, việc kiểm soát và đánh giá rủi ro của Claude Mythos trở nên tối quan trọng. Tuy nhiên, Anthropic đang áp dụng chính sách hạn chế quyền truy cập đối với mô hình này, chỉ cấp phép cho một số đối tác chọn lọc. Chính sách này đã tạo ra một sự phân hóa rõ rệt trong khả năng tiếp cận và kiểm định công nghệ AI tiên tiến giữa các quốc gia và khu vực.

Châu Âu "đứng ngoài cuộc": Vì sao thiếu quyền tiếp cận Claude Mythos?

Trong khi Claude Mythos đang gây xôn xao, phần lớn các cơ quan an ninh mạng quốc gia tại châu Âu lại có rất ít hoặc không có liên hệ trực tiếp với Anthropic về mô hình này. Theo thông tin từ POLITICO, sau khi khảo sát các quan chức từ tám cơ quan an ninh mạng quốc gia châu Âu, chỉ có Cơ quan An toàn Thông tin Liên bang Đức (BSI) xác nhận đã mở các cuộc đàm phán với Anthropic về Mythos, nhưng vẫn chưa thể trực tiếp thử nghiệm mô hình. Các tổ chức chính phủ khác của châu Âu dường như chỉ có thông tin rất hạn chế.

Bà Claudia Plattner, người đứng đầu BSI, nhấn mạnh rằng việc các công cụ mạnh mẽ như Mythos có sẵn trên thị trường mở hay không là một câu hỏi cấp bách, mang ý nghĩa sâu sắc đối với an ninh và chủ quyền quốc gia cũng như châu Âu. Mặc dù BSI đang đối thoại tích cực với Anthropic, những cuộc trao đổi này cho đến nay chỉ cung cấp cái nhìn về cách thức hoạt động của mô hình chứ không phải quyền truy cập trực tiếp để thử nghiệm.

Anh Quốc đi trước một bước trong kiểm định an toàn AI tiên tiến

Trái ngược hoàn toàn với tình hình tại EU, Anh Quốc lại ở một vị thế khác biệt. Bộ trưởng AI Anh, Kanishka Narayan, đã xác nhận rằng Viện An ninh AI Anh (AISI) gần đây đã thử nghiệm Claude Mythos và đã có những hành động dựa trên kết quả. Viện này đã công bố đánh giá của mình, cho thấy Mythos Preview đại diện cho một bước nhảy vọt đáng kể so với các mô hình AI tiên tiến trước đây trong lĩnh vực an ninh mạng.

AISI lưu ý rằng họ không thể khẳng định chắc chắn liệu Mythos có thể tấn công thành công các hệ thống được bảo vệ tốt hay không, nhưng việc họ có quyền tiếp cận và thử nghiệm sớm đã giúp Anh Quốc có được lợi thế đáng kể trong việc hiểu và chuẩn bị cho các rủi ro tiềm tàng từ các mô hình AI thế hệ mới.

"Việc Anh Quốc có thể tiếp cận và kiểm định sớm các mô hình AI tiên tiến như Mythos cho thấy một chiến lược chủ động và hiệu quả trong việc đảm bảo an toàn AI quốc gia. Đây là điều mà EU cần học hỏi."

Hệ quả của việc thiếu dữ liệu kỹ thuật trong đánh giá rủi ro AI

Việc châu Âu thiếu quyền truy cập vào Claude Mythos không chỉ là một vấn đề quản trị đơn thuần. Không có dữ liệu kỹ thuật cụ thể, các nhà quản lý chỉ có thể làm được rất ít để đánh giá rủi ro và ưu tiên các biện pháp phòng vệ. Điều này tạo ra một lỗ hổng lớn trong chiến lược an toàn AI châu Âu.

Daniel Privitera, người sáng lập tổ chức phi lợi nhuận về AI KIRA có trụ sở tại Berlin, nhận định rằng Mythos là một ví dụ ban đầu về tầm quan trọng của việc tiếp cận các năng lực AI tiên tiến trong những năm tới. Ông cho rằng châu Âu hiện chưa có kế hoạch nào để đảm bảo quyền tiếp cận này.

Nhà tiên phong AI Yoshua Bengio bày tỏ sự lo ngại sâu sắc khi các công ty công nghệ, chứ không phải các nhà quản lý, lại là người quyết định cách xử lý những rủi ro này. Điều này cho thấy tầm quan trọng của việc tạo ra các kênh để chính phủ hoặc bên thứ ba có thể xem xét công nghệ. Cựu thành viên Nghị viện Châu Âu Marietje Schaake cũng cho rằng việc các mô hình có tác động sâu rộng lại do một công ty tư nhân kiểm soát là đáng lo ngại, và đây là thời điểm thích hợp để thống nhất các quy tắc công bố và cơ chế giám sát.

Laura Caroli, một nhà nghiên cứu AI độc lập tham gia soạn thảo Đạo luật AI của EU, cho biết EU đã bị gạt ra ngoài lề vì mô hình này chưa được phát hành ra thị trường. Nếu được phát hành, Anthropic sẽ phải đối mặt với các nghĩa vụ ràng buộc theo luật pháp EU. Tuy nhiên, theo hướng dẫn của EU, ngay cả việc sử dụng nội bộ một mô hình AI cũng được tính là đưa nó ra thị trường nếu việc sử dụng đó là cần thiết để cung cấp sản phẩm hoặc dịch vụ tại EU hoặc ảnh hưởng đến quyền của các cá nhân trong Liên minh.

Luật pháp AI của EU có đủ mạnh để kiểm soát các mô hình như Mythos?

Ủy ban Châu Âu đang xem xét các tác động có thể có theo luật pháp EU. Theo Đạo luật AI (EU AI Act), các nhà cung cấp như Anthropic phải giải quyết các rủi ro an ninh mạng do mô hình của họ gây ra. Ngoài ra, Đạo luật An ninh mạng (Cyber Resilience Act) cũng đặt ra các yêu cầu bắt buộc về an ninh mạng đối với tất cả các sản phẩm có thành phần kỹ thuật số được bán trên thị trường EU.

Mặc dù EU có khung pháp lý khá toàn diện, vấn đề chính vẫn là khả năng thực thi và kiểm định. Nếu các cơ quan quản lý không thể tiếp cận và thử nghiệm trực tiếp các mô hình AI tiên tiến như Claude Mythos, việc áp dụng các quy định này sẽ trở nên khó khăn. Điều này nhấn mạnh khoảng cách giữa lý thuyết pháp lý và thực tiễn kiểm định công nghệ.

Nguyên nhân sâu xa: Vì sao EU chưa thể "ngang tầm" Anh trong an toàn AI?

Việc châu Âu thiếu quyền tiếp cận Mythos có phải là triệu chứng của việc "quá nhiều quy định" không? Thực tế phức tạp hơn nhiều. Anthropic đã ký Bộ Quy tắc Ứng xử EU về các mô hình AI đa năng, cùng với Amazon, Google, IBM, Microsoft và OpenAI. Vấn đề không phải là thiếu thiện chí hợp tác từ phía các công ty.

Nguyên nhân thực sự là châu Âu thiếu một đối tác có thể hoạt động ở cùng cấp độ kỹ thuật. Viện An ninh AI Anh (AISI), được thành lập vào năm 2023 với tên gọi Frontier AI Taskforce và đổi tên vào năm 2025, có nguồn tài trợ công 100 triệu bảng Anh. Trong một thời gian ngắn đáng kinh ngạc, AISI đã tiếp cận được ngành công nghiệp AI bằng cách thực hiện các bài kiểm tra an toàn và tuyển dụng các nhà nghiên cứu hàng đầu từ OpenAI và Google Deepmind. Cho đến nay, họ đã thử nghiệm ít nhất 16 mô hình, bao gồm ba mô hình tiên tiến trước khi ra mắt công khai. Với hơn 100 nhân viên kỹ thuật và các mối quan hệ phù hợp, AISI có đủ uy tín để tiếp cận sớm các mô hình tiên tiến nhất.

Ở cấp độ EU, Văn phòng AI của EU (EU AI Office) cũng tồn tại với hơn 125 nhân viên và một đơn vị an toàn riêng. Tuy nhiên, theo Transformer News, vào mùa thu năm ngoái, văn phòng này vẫn đang gặp khó khăn lớn trong việc tuyển dụng. Các vị trí lãnh đạo chủ chốt vẫn còn trống. Cấu trúc lương cứng nhắc khiến việc thu hút nhân tài từ khu vực tư nhân trở nên khó khăn, theo chuyên gia nhân sự EU Andras Baneth. Quy trình tuyển dụng kéo dài cũng là một trở ngại. Đây chính là điểm yếu cốt lõi ảnh hưởng đến khả năng kiểm định và đảm bảo an toàn AI châu Âu.

Ưu điểm của mô hình Anh Quốc

- Tài trợ công lớn (100 triệu bảng Anh).

- Tiếp cận sớm các mô hình AI tiên tiến để kiểm định.

- Tuyển dụng nhân tài hàng đầu từ ngành công nghiệp.

- Nhanh chóng đưa ra đánh giá và hành động.

Hạn chế của mô hình EU

- Thiếu quyền truy cập trực tiếp vào các mô hình AI tiên tiến.

- Khó khăn trong việc tuyển dụng nhân tài kỹ thuật.

- Cấu trúc lương cứng nhắc, kém cạnh tranh.

- Quy trình đánh giá chậm hơn, phụ thuộc vào việc mô hình được "thị trường hóa".

Điều này có nghĩa gì với bạn?

Đối với người dùng và doanh nghiệp tại Việt Nam, câu chuyện về Claude Mythos và sự khác biệt giữa EU, Anh Quốc trong việc kiểm định AI mang ý nghĩa quan trọng. Nó cho thấy rằng, ngay cả những cường quốc công nghệ cũng đang vật lộn với việc quản lý và đảm bảo an toàn cho các công nghệ AI tiên tiến. Điều này đặt ra yêu cầu cao hơn cho các quốc gia đang phát triển như Việt Nam trong việc xây dựng năng lực kiểm định, giám sát và phát triển chính sách AI phù hợp.

Việc thiếu quyền truy cập vào các mô hình AI "hộp đen" có thể dẫn đến rủi ro an ninh mạng tiềm ẩn mà không ai có thể lường trước. Các doanh nghiệp và tổ chức cần thận trọng khi tích hợp AI vào hệ thống của mình, đặc biệt là các mô hình từ bên thứ ba. Đồng thời, cần có sự đầu tư vào nghiên cứu và phát triển AI nội địa, cũng như xây dựng đội ngũ chuyên gia có khả năng đánh giá độc lập các công nghệ AI nhập khẩu. Bài học từ châu Âu là một lời nhắc nhở rằng an toàn AI không chỉ là trách nhiệm của nhà phát triển mà còn là của toàn xã hội và chính phủ.

Điểm Chính Cần Nhớ

- Mô hình AI Claude Mythos của Anthropic có khả năng phát hiện lỗ hổng bảo mật vượt trội, nhưng bị hạn chế quyền truy cập.

- EU đang gặp khó khăn nghiêm trọng trong việc tiếp cận và kiểm định Mythos, làm suy yếu năng lực đảm bảo an toàn AI châu Âu.

- Anh Quốc, với Viện An ninh AI (AISI) được tài trợ tốt và đội ngũ chuyên gia, đã thành công trong việc thử nghiệm sớm các mô hình AI tiên tiến.

- Vấn đề không nằm ở quy định mà là ở việc EU thiếu một cơ quan kỹ thuật đủ mạnh và linh hoạt để đối trọng với các công ty AI lớn.

- Bài học này nhấn mạnh tầm quan trọng của việc đầu tư vào năng lực kiểm định và chính sách AI chủ động cho mọi quốc gia.