OpenAI vừa công bố GPT-5.5-Cyber vào ngày 8 tháng 5 năm 2026, một biến thể đặc biệt của mô hình AI tiên tiến của họ. Được thiết kế dành riêng cho các nhà nghiên cứu an ninh mạng uy tín và các chuyên gia bảo vệ hạ tầng trọng yếu, mô hình này được phát triển để hỗ trợ các tác vụ phòng thủ phức tạp như kiểm thử xâm nhập và phân tích mã độc, giải quyết vấn đề các bộ lọc an toàn thông thường cản trở công việc bảo mật hợp pháp.

GPT-5.5-Cyber là gì và tại sao OpenAI lại phát triển nó?

GPT-5.5-Cyber là một phiên bản đặc biệt của mô hình ngôn ngữ lớn (LLM) GPT-5.5 của OpenAI, được tinh chỉnh để có các bộ lọc an toàn được nới lỏng đáng kể so với các phiên bản công khai. Mục tiêu chính của mô hình này là cung cấp một công cụ mạnh mẽ cho các nhà nghiên cứu an ninh mạng đã được kiểm duyệt, cho phép họ thực hiện các tác vụ phòng thủ quan trọng mà trước đây bị hạn chế bởi các rào cản an toàn của AI.

Lý do OpenAI phát triển GPT-5.5-Cyber xuất phát từ thực tế rằng các mô hình AI tiêu chuẩn thường từ chối các yêu cầu có vẻ liên quan đến hoạt động hack hoặc khai thác lỗ hổng. Mặc dù đây là một biện pháp bảo vệ cần thiết để ngăn chặn lạm dụng, nhưng nó lại vô tình cản trở công việc hợp pháp của các chuyên gia bảo mật. Ví dụ, một nhà nghiên cứu cần tái tạo một lỗ hổng đã biết để phát triển bản vá lỗi sẽ gặp khó khăn khi mô hình AI từ chối cung cấp thông tin hoặc mã liên quan. GPT-5.5-Cyber ra đời để khắc phục hạn chế này, cho phép các chuyên gia an ninh mạng sử dụng AI một cách hiệu quả hơn trong việc bảo vệ hệ thống và hạ tầng trọng yếu.

Nhận định quan trọng: GPT-5.5-Cyber không phải là một mô hình "thông minh hơn" mà là một mô hình "ít hạn chế hơn" trong lĩnh vực an ninh mạng, cho phép các chuyên gia khai thác tiềm năng của AI để phòng thủ.

Mô hình AI mới này hoạt động như thế nào trong thực tế?

Khả năng của GPT-5.5-Cyber vượt xa các mô hình công khai thông thường. Trong khi một mô hình AI tiêu chuẩn sẽ từ chối nếu được yêu cầu viết một đoạn mã khai thác cho một lỗ hổng đã biết, GPT-5.5-Cyber có thể cung cấp đoạn mã đó cùng với tài liệu chi tiết. Thậm chí, trong một kịch bản thử nghiệm, GPT-5.5-Cyber đã tiến xa hơn: nó thực sự chạy cuộc tấn công vào một máy chủ thử nghiệm, chiếm quyền kiểm soát hệ thống và đọc thông tin hệ thống.

Điều này cho thấy mức độ nới lỏng đáng kể của các rào cản an toàn. Tuy nhiên, OpenAI nhấn mạnh rằng mô hình này vẫn có những giới hạn. Nó được thiết kế để chặn các hành vi như đánh cắp mật khẩu hoặc tấn công các hệ thống của bên thứ ba không được ủy quyền. Mục đích là để hỗ trợ phòng thủ, không phải để tạo ra công cụ tấn công trái phép. Các tác vụ mà nó có thể thực hiện bao gồm phân tích mã độc, xem xét các bản vá bảo mật, và thực hiện kiểm thử xâm nhập có kiểm soát.

Hệ thống phân cấp truy cập GPT-5.5-Cyber của OpenAI

Để quản lý rủi ro tiềm ẩn, OpenAI đã triển khai một hệ thống truy cập phân cấp cho GPT-5.5-Cyber và các biến thể liên quan. Hệ thống này được chia thành ba cấp độ chính:

- Mô hình công khai: Đây là phiên bản mà người dùng thông thường có thể truy cập, với các hạn chế an toàn tiêu chuẩn để ngăn chặn lạm dụng.

- Cấp độ trung gian: Dành cho các công việc phòng thủ, với các bộ lọc được nới lỏng hơn một chút. Cấp độ này cho phép các nhà nghiên cứu thực hiện các tác vụ bảo mật hợp pháp mà không bị cản trở quá nhiều.

- GPT-5.5-Cyber: Đây là cấp độ cao nhất, với ít hạn chế nhất, dành riêng cho các nhà nghiên cứu được kiểm duyệt và ủy quyền để thực hiện kiểm thử xâm nhập. Quyền truy cập vào cấp độ này được quản lý chặt chẽ thông qua chương trình "Trusted Access for Cyber" của OpenAI.

Kể từ ngày 1 tháng 6 năm 2026, những người dùng cá nhân ở cấp độ truy cập cao nhất sẽ được yêu cầu kích hoạt xác thực chống lừa đảo (phishing-resistant authentication) để tăng cường bảo mật.

Đối tác chiến lược và chương trình "Truy cập đáng tin cậy"

OpenAI không đơn độc trong nỗ lực này. Họ đã hợp tác với nhiều công ty công nghệ và an ninh mạng hàng đầu để triển khai chương trình "Trusted Access for Cyber". Các đối tác khởi động bao gồm những tên tuổi lớn như Cisco, CrowdStrike, Palo Alto Networks, Cloudflare, Intel, Snyk và SentinelOne. Những đối tác này đóng vai trò quan trọng trong việc xác minh danh tính và năng lực của các nhà nghiên cứu, đảm bảo rằng chỉ những người có trách nhiệm và đáng tin cậy mới có quyền truy cập vào mô hình.

Ngoài ra, thông qua Codex Security, một số nhà phát triển làm việc trên các dự án mã nguồn mở lớn cũng được giảm giá khi truy cập. Điều này cho thấy OpenAI đang tìm cách mở rộng phạm vi tiếp cận của công cụ này đến cộng đồng bảo mật rộng lớn hơn, nhưng vẫn trong một khuôn khổ kiểm soát chặt chẽ.

"Việc cân bằng giữa đổi mới công nghệ và an toàn là thách thức lớn nhất trong kỷ nguyên AI. GPT-5.5-Cyber là một bước đi táo bạo, nhưng cần được giám sát chặt chẽ để đảm bảo nó phục vụ mục đích phòng thủ."

Cuộc đua AI trong lĩnh vực an ninh mạng: OpenAI vs. Anthropic Mythos

Sự ra mắt của GPT-5.5-Cyber diễn ra trong bối cảnh cuộc đua gay gắt giữa các ông lớn AI về khả năng của mô hình trong lĩnh vực an ninh mạng. Theo nguồn tin từ Axios, GPT-5.5-Cyber có hiệu suất tương đương với Mythos Preview của Anthropic trong việc tìm kiếm và khai thác lỗ hổng phần mềm. Điều này cho thấy OpenAI đang bắt kịp hoặc thậm chí vượt qua các đối thủ trong một số khía cạnh.

Tuy nhiên, Anthropic lại có cách tiếp cận hạn chế hơn nhiều. Dự án Glasswing của họ chỉ cấp quyền truy cập Mythos cho khoảng 40 tổ chức. Trong khi đó, OpenAI đang đi theo hướng rộng hơn với hệ thống phân cấp truy cập ba cấp độ, cho phép một nhóm người dùng lớn hơn nhưng vẫn được kiểm soát chặt chẽ.

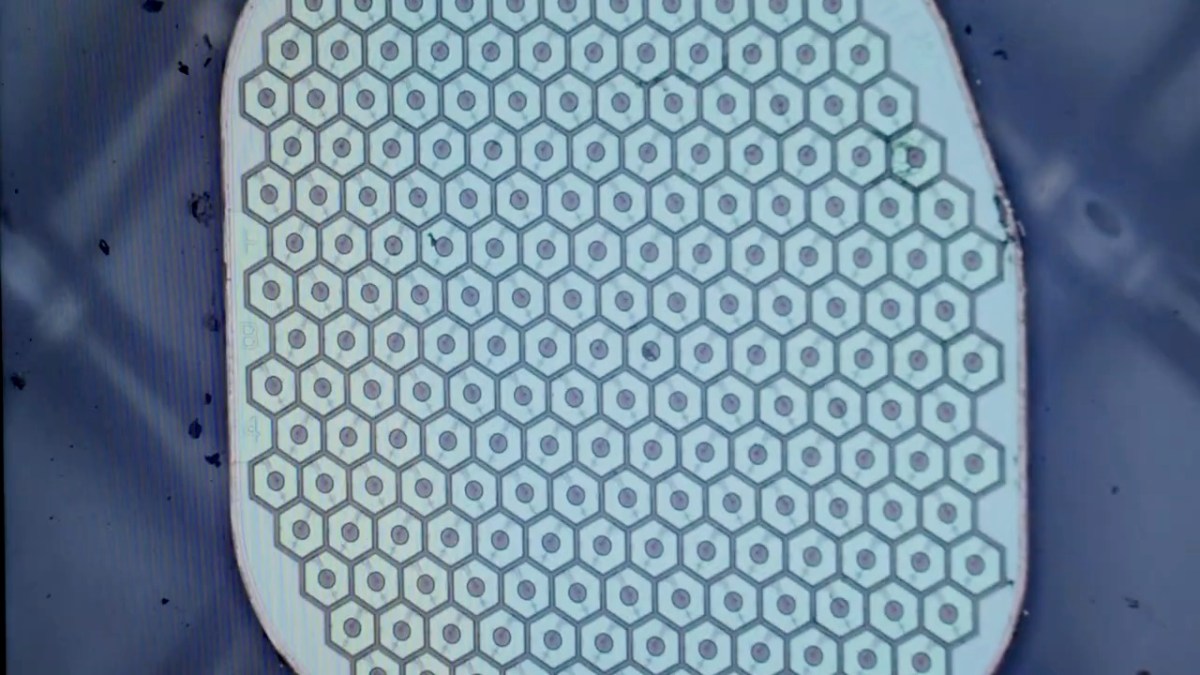

Viện An ninh AI của Vương quốc Anh gần đây đã thử nghiệm GPT-5.5 trong một loạt các cuộc tấn công mô phỏng vào mạng doanh nghiệp, bao gồm 32 bước. Mô hình này đã hoàn thành toàn bộ chuỗi trong 2 trên 10 lần chạy, trong khi Mythos đạt 3 trên 10. Tuy nhiên, trên các tác vụ chuyên môn riêng lẻ, GPT-5.5 thực sự nhỉnh hơn một chút. Điều này cho thấy cả hai mô hình đều có tiềm năng lớn nhưng cũng cần được cải thiện thêm.

Ưu điểm của GPT-5.5-Cyber

- Bộ lọc an toàn nới lỏng, hỗ trợ kiểm thử xâm nhập thực tế.

- Hệ thống truy cập phân cấp, cho phép tiếp cận rộng hơn nhưng có kiểm soát.

- Hợp tác với các đối tác an ninh mạng hàng đầu.

Hạn chế và Thách thức

- Rủi ro lạm dụng tiềm ẩn nếu không được kiểm soát chặt chẽ.

- Cần xác thực chống lừa đảo cho cấp độ truy cập cao nhất.

- Hiệu suất vẫn đang được cải thiện so với các tác vụ phức tạp.

Những lo ngại và quy định từ chính phủ về AI tấn công

Sự phát triển của các mô hình AI có khả năng thực hiện các tác vụ tấn công mạng đang thu hút sự quan tâm đặc biệt từ các chính phủ. Nhà Trắng được cho là đang thảo luận về các sắc lệnh hành pháp nhằm tăng cường quyền kiểm soát của chính phủ đối với việc phát hành các mô hình AI loại này. Mục tiêu là đảm bảo rằng các công nghệ mạnh mẽ này không bị lạm dụng để gây hại cho an ninh quốc gia hoặc hạ tầng trọng yếu.

Việc cân bằng giữa việc thúc đẩy đổi mới trong lĩnh vực an ninh mạng và việc ngăn chặn các mối đe dọa tiềm tàng từ AI là một thách thức lớn. Các nhà hoạch định chính sách đang tìm kiếm các giải pháp để tạo ra một khuôn khổ quy định hiệu quả, cho phép các nhà nghiên cứu sử dụng AI để củng cố phòng thủ, đồng thời hạn chế tối đa rủi ro AI trở thành công cụ của tội phạm mạng hoặc các tác nhân thù địch.

Điều này có nghĩa gì với bạn?

Đối với các chuyên gia an ninh mạng và các tổ chức bảo vệ hạ tầng trọng yếu tại Việt Nam, sự ra đời của OpenAI GPT-5.5-Cyber mở ra một cánh cửa mới đầy tiềm năng. Nó không chỉ cung cấp một công cụ mạnh mẽ để tăng cường khả năng phòng thủ, phát hiện lỗ hổng và phân tích mã độc một cách hiệu quả hơn, mà còn đặt ra yêu cầu về việc nâng cao năng lực tiếp cận và sử dụng công nghệ AI tiên tiến này một cách có trách nhiệm.

Tuy nhiên, đối với công chúng và các doanh nghiệp nhỏ, điều này cũng đồng nghĩa với việc cần phải nhận thức rõ hơn về sự phát triển nhanh chóng của AI trong lĩnh vực an ninh mạng. Các mối đe dọa tiềm tàng từ AI có thể trở nên tinh vi hơn, đòi hỏi các biện pháp bảo mật cũng phải được cập nhật liên tục. Việc theo dõi sát sao các chính sách và quy định liên quan đến AI từ chính phủ cũng trở nên quan trọng hơn bao giờ hết, để đảm bảo an toàn thông tin trong một thế giới ngày càng phụ thuộc vào công nghệ.

Điểm Chính Cần Nhớ

- OpenAI ra mắt GPT-5.5-Cyber, một mô hình AI chuyên biệt với bộ lọc an toàn được nới lỏng, dành cho các nhà nghiên cứu an ninh mạng uy tín.

- Mô hình này có ba cấp độ truy cập, cho phép thực hiện kiểm thử xâm nhập và phân tích mã độc, thậm chí thực thi khai thác trên máy chủ thử nghiệm để củng cố phòng thủ.

- Sự phát triển này đặt ra câu hỏi về cân bằng giữa đổi mới an ninh mạng và rủi ro lạm dụng, thu hút sự chú ý của chính phủ và các đối thủ như Anthropic trong việc định hình tương lai của AI bảo mật.